총 181 건

-

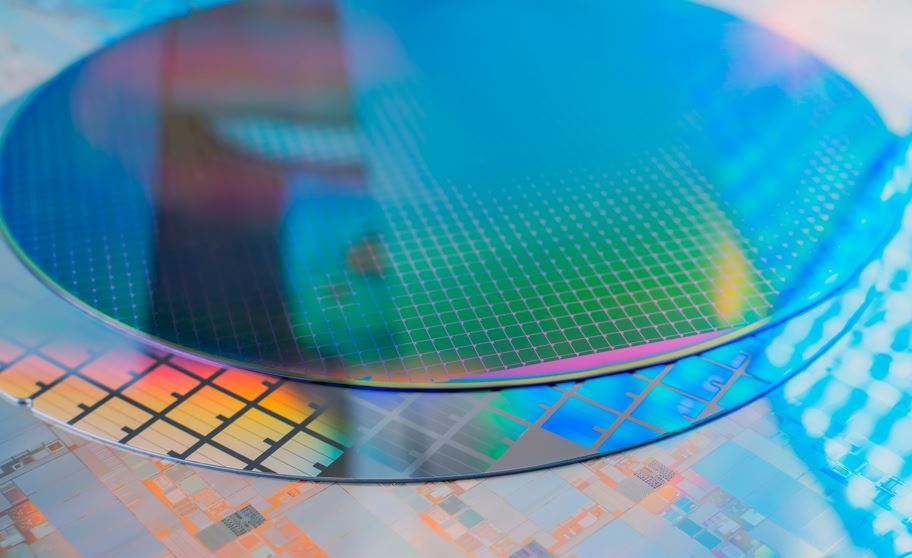

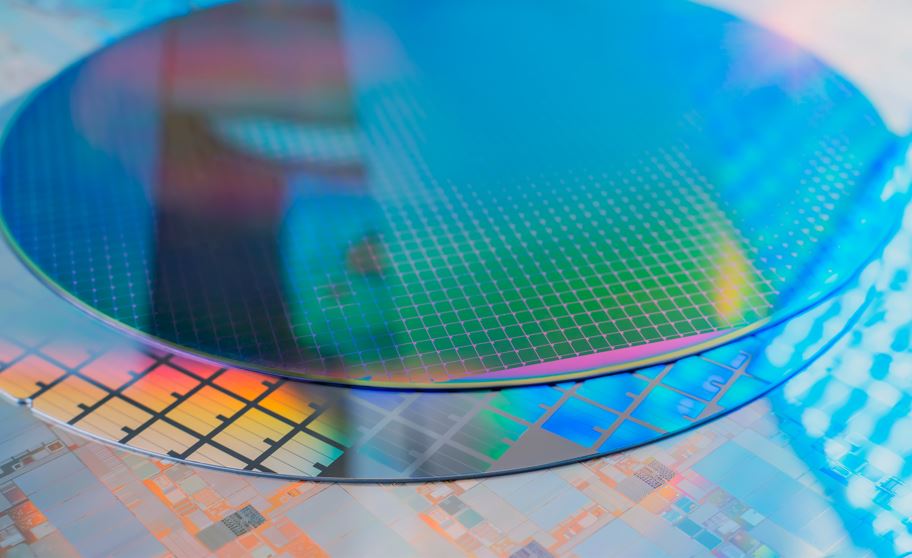

VS Technology의 다양한 어플리케이션 - 실리콘 웨이퍼 얼라인먼트

VS Technology의 다양한 어플리케이션 - 실리콘 웨이퍼 얼라인먼트실리콘 웨이퍼 얼라인먼트 두깨 측정 장치의 프로세스중 측정을 하기 전 실리콘 웨이터를 얼라인 하기 위해 추천드리는 제품은 VS-THV-SWIR 시리즈입니다. VS-THV-SWIR 시리즈 적용 사례 도입전 과제 - 웨이퍼의 뒷면을 보기 위함 - 가시광이 아닌 적외선을 사용하여 투과 시킨뒤 촬영을 하고 있었음. - 기존 렌즈는 밝기가 부족하여 검사 속도가 느림. VS-THV-SWIR 평가와 선정 이유 - 기존 텔레센트릭 렌즈보다 4배 정도 더 밝아져 문제 해결. VS-THV-SWIR 시리즈 요약(이미지 클릭시 제품페이지로 이동) - 1000~1600nm의 투과율 - 근적외선까지 대응 가능한 설계 - 1.1" & 1" 센서 대응 - 1.0x, 1.5x, 2.0x, 3.0x, 4.0x 총 5종의 라인업 - 전 제품 가변 조리개 대응 가능 - 전 제품 동축 조명 대응 가능

2022.08.31 -

VS Technology의 다양한 어플리케이션 - 실리콘 웨이퍼 이물 검사

VS Technology의 다양한 어플리케이션 - 실리콘 웨이퍼 이물 검사실리콘 웨이퍼 이물 검사 실리콘 웨이퍼에 패터닝 된 회로의 이상 및 이물질 검사의 정확도를 높이기 위한 제품은 VS-THV-SWIR시리즈입니다. VS-THV-SWIR 시리즈 적용 사례 도입전 과제 - 분해능을 높여 검사 정확도를 높이는 것이 목표. - 촬영 영역을 확대해 생산 속도를 높이는 것이 목표. VS-THV-SWIR 평가와 선정 이유 - 최신 고해상도 센서와 호환 가능하며 분해능을 개선함. - SWIR의 높은 투과율로 생산 속도 향상. VS-THV-SWIR 시리즈 요약(이미지 클릭시 제품페이지로 이동) - 1000~1600nm의 투과율 - 근적외선까지 대응 가능한 설계 - 1.1" & 1" 센서 대응 - 1.0x, 1.5x, 2.0x, 3.0x, 4.0x 총 5종의 라인업 - 전 제품 가변 조리개 대응 가능 - 전 제품 동축 조명 대응 가능

2022.08.31 -

VS Technology의 다양한 어플리케이션 - 차량용 대형 부품 치수 측정

VS Technology의 다양한 어플리케이션 - 차량용 대형 부품 치수 측정차량용 대형 부품 치수 측정 EV모터에 사용되는 대형 부품의 치수 검사시 추천 드리는 제품은 VS-TLS 시리즈입니다. VS-TLS 시리즈 적용 사례 도입전 과제 - 크고 무거운 부품을 별도로 촬영하려면 많은 시간이 소요됨. - 분할된 이미지를 불러올 때 이미지 처리 과정에서 요류가 발생할 수 있음. VS-TLS 평가와 선정 이유 - 넓은 시야와 낮은 배율의 VS-TLS를 사용하여 부품 전체를 한번에 촬영할 수 있어 생산 속도가 향상됨. - 분해능이 뛰어나 부품 전체를 촬영 후 해상 처리하는 방법에서 메리트가 높음. VS-TLS 시리즈 요약(이미지 클릭시 제품페이지로 이동) - 최대 12MP 1.1인치 센서 대응가능 - 전면 유닛(후면 유닛 재구성 가능) - 3.45um 해상도 - 0.029~0.1배 까지 6종의 라인업 - 후면 유닛 변경으로 배율 변경 가능 - 초점 조정으로 WD 미세 조정 가능 - 저왜곡 설계 - C-Mount

2022.08.31 -

VS Technology의 다양한 어플리케이션 - 유리병 검사 및 치수 검사

VS Technology의 다양한 어플리케이션 - 유리병 검사 및 치수 검사유리병 검사 및 치수 검사 유리병의 외관 검사, 치수 측정과 같은 검사에 추천 드리는 제품은 VS-TLS 시리즈 입니다. VS-TLS 시리즈 적용 사례 도입전 과제 - 유리병은 제작 단계에서 불량률이 높기 때문에 육안으로 검수를 하고 있다. - 육안 검사를 자동화하여 검사 기준을 평준화하는 것이 목표 - 외관 검사 및 치수 측정을 하나의 카메라와 렌즈로 하는 조건 VS-TLS 평가와 선정 이유 - 외관 검사와 치수 측정이 동시에 가능 - 물체의 크기가 달라져도 대응이 가능하여 생산 속도가 향상됨 VS-TLS 시리즈 요약(이미지 클릭시 제품페이지로 이동) - 최대 12MP 1.1인치 센서 대응가능 - 전면 유닛(후면 유닛 재구성 가능) - 3.45um 해상도 - 0.029~0.1배 까지 6종의 라인업 - 후면 유닛 변경으로 배율 변경 가능 - 초점 조정으로 WD 미세 조정 가능 - 저왜곡 설계 - C-Mount

2022.08.31 -

Xscale 픽셀 크기, 감도 및 해상도 요건을 모두 충족시킬 수 있는 서브 픽셀 크기조정

Xscale 픽셀 크기, 감도 및 해상도 요건을 모두 충족시킬 수 있는 서브 픽셀 크기조정Xscale 픽셀 크기, 감도 및 해상도 요건을 모두 충족시킬 수 있는 서브 픽셀 크기 조정 CMOS 센서 기술은 다양한 픽셀 크기와 해상도로 제공되고 있습니다. 그러나 머신 비전 설계자가 특정 애플리케이션에 적합한 카메라를 찾는 것은 말처럼 쉽지 않습니다. 구형 카메라를 새로운 카메라로 교체해야 하는 경우, 새 카메라의 픽셀 크기가 달라져 해상도를 변경하거나 기존 시스템의 FOV를 변경해야 할 수 있습니다. 또는 2x2 또는 4x4 비닝에 필요한 만큼의 해상도를 희생하지 않으면서 픽셀을 결합하여 감도를 높이고 싶을 수 있습니다. 또는 단순히 비닝을 사용하여 컬러 카메라의 감도를 높이고 싶지만 선호하는 카메라가 컬러 비닝을 지원하지 않을 수도 있습니다. JAI의 Xscale을 통해 이런 문제를 해결할 수 있습니다. Xscale의 특장점 Xscale을 사용하면 기존 비닝보다 훨씬 유연하게 픽셀 크기, 해상도, 감도 및 신호대 노이즈 비율을 조정할 수 있습니다. 기존의 비닝은 2x1, 2x2, 4x4 등과 같이 "전체" 픽셀의 조합으로 제한되었습니다. 반면 Xscale은 부동 소수점 수를 사용하여 픽셀의 일부분을 전체 픽셀과 결합하여 정확히 필요한 크기의 "가상" 픽셀을 생성할 수 있습니다. Xscale은 다음의 기능을 지원합니다. ● 합산을 사용하여 더 높은 감도의 픽셀 생성 ● 평균화를 사용하여 더 뛰어난 신호 대 노이즈 비율(SNR)의 픽셀 생성 ● 필요한 픽셀 크기와 해상도/FOV를 모두 일치시키기 위한 ROI와 크기 조정 결합 ● 흑백, Bayer 또는 RGB 픽셀 형식의 크기 조정 가능 독립적인 H & V 크기 조정 Xscale은 픽셀 크기 재조정을 위한 뛰어난 유연성을 제공합니다. 오늘날 대부분의 CMOS 센서에는 정사각형 픽셀이 장착되어 있지만 특정 프로젝트에 직사각형 픽셀이 필요한 경우가 발생할 수 있습니다. 이를 위해서는 픽셀을 직사각형 픽셀이 장착된 구형 카메라의 형식에 맞추거나 1x2 또는 2x1과 같은 비대칭 비닝 구성에 맞춰야 할 수 있습니다. Xscale은 목표로 하는 픽셀 크기와 모양에 맞출 수 있도록 수평 및 수직 방향으로의 다양한 크기 조정을 지원합니다. 최대 16:1 크기 조정 비닝은 일반적으로 크기가 2배 또는 때로는 4배로 제한되지만 Xscale은 센서의 기본 픽셀 크기의 최대 16배까지 크기 조정을 지원합니다. 40µm 픽셀의 집광 기능이 필요하신가요? Xscale의 16:1 크기 조정 범위를 사용하면 가능합니다. JAI의 Xscale 카메라 Xscale 기능은 Sony Pregius S CMOS 센서가 탑재된 JAI Go-X 시리즈 카메라에 표준 기능으로 탑재되어 있습니다. Xscale 기능이 포함된 모델은 현재 CoaXPress 인터페이스가 탑재된 12개 모델과 1000BASE-T GigE Vision 인터페이스가 탑재된 12개 모델입니다. Pregius S 센서, 5GBASE-T GigE Vision 인터페이스 및 Xscale 기능이 탑재된 12개의 추가 Go-X 모델은 2022년 4분기에 출시될 예정입니다. Xscale이 탑재된 카메라는 5.1~24.5 메가픽셀의 기본 해상도를 제공합니다. 기본 픽셀 크기는 2.74μm입니다. 자세한 내용은 Go-X 시리즈 페이지(www.jai.com/kr/go-x-series)를 참조하시기 바랍니다.

2022.07.19 -

Xpress 더 빠른 GigE Vision 출력을 위한 무손실 압축

Xpress 더 빠른 GigE Vision 출력을 위한 무손실 압축Xpress 더 빠른 GigE Vision 출력을 위한 무손실 압축 오늘날 CMOS 카메라의 속도와 해상도가 증가함에 따라 머신 비전 설계자들은 어려운 선택에 놓여있습니다. GigE Vision 표준 인터페이스를 계속 사용하는 경우 네트워킹 기능, 긴 케이블 길이, PC 직접 연결과 같은 많은 이점이 있지만 GigE Vision의 크지 않은 대역폭 용량에 따른 낮은 프레임 속도에 만족해야 합니다. CoaXPress, Camera Link 또는 10 GigE Vision과 같은 고용량 인터페이스를 사용할 수도 있지만 이러한 기술은 더 높은 비용과 복잡성을 요구합니다. JAI의 Xpress는 GigE Vision 표준의 이점을 유지하면서 프레임 속도를 기본 대역폭 한계 이상으로 높일 수 있는 세 번째 옵션을 제공합니다. Xpress 기능이란? Xpress는 이미지 데이터의 크기를 줄인 후 호스트 PC에서 완벽하게 재구성할 수 있는 무손실 압축 알고리즘을 제공합니다. 압축은 이미지 중복 원리를 사용하여 카메라의 FPGA에서 수행됩니다. 구체적으로 설명하면, Xpress 알고리즘은 이미지를 작은 픽셀 블록으로 분해하고 이미지에서 동일한 픽셀 패턴을 가진 다른 블록을 찾습니다. 이러한 중복 블록을 짧은 코드로 표시하여 "인코딩"하면 카메라에서 출력되는 이미지 데이터의 전체 크기를 크게 줄일 수 있습니다. 이미지 크기가 작아지기 때문에 GigE Vision 대역폭을 통해 프레임을 더 빠르게 전송할 수 있습니다. 매우 "복잡한" 이미지의 경우 약간의 속도 향상부터 높은 수준의 균일성을 가진 이미지의 경우 최대 100%의 속도 증가에 이르기까지 속도 향상은 이미지가 중복되는 양에 따라 달라집니다. 예를 들어, 이미지 파일의 크기를 30% 줄이는 경우 프레임 속도가 표준 GigE Vision 연결에 비해 약 42% 증가합니다. 또한 Xpress를 통해 파일 크기가 작아지면 현재 프레임 속도를 유지하면서 동일 네트워크를 공유하는 카메라의 수를 늘릴 수도 있습니다. 무손실 압축 해제 인코딩된 픽셀 데이터를 본래의 픽셀 패턴으로 교체하면 이미지 품질이나 디테일의 손실 없이 전송된 이미지를 완벽하게 재구성할 수 있습니다. Xpress 압축 해제 라이브러리를 사용하면 개발자는 이미지 처리 루틴을 위해 애플리케이션 코드에 몇 가지 함수를 간단히 추가하여 GigE Vision 데이터의 압축을 쉽게 해제할 수 있습니다. 예시적인 목적으로만 제공됩니다. 올바른 사용법은 카메라 매뉴얼이나 소프트웨어 문서를 참조하세요. Xpress 압축 해제 소프트웨어는 JAI 웹사이트에서 다운로드할 수 있습니다. JAI의 Xpress 카메라 Xpress 무손실 압축은 Sony Pregius S CMOS 센서가 탑재된 JAI의 흑백 Go-X 시리즈 GigE Vision 카메라에 표준 기능으로 포함되어 있습니다. Xpress가 탑재된 카메라의 기본 해상도는 5.1~24.5 메가픽셀이며 표준(비압축) 프레임 속도는 23fps~4fps입니다. 자세한 내용은 Go-X 시리즈 페이지(www.jai.com/kr/go-x-series)를 참조하시기 바랍니다. * 프레임 속도는 이미지 콘텐츠에 따라 달라집니다. 일반적으로 최대 속도의 40%-50%입니다.

2022.07.19 -

여러 카메라 제조사와 인터페이스를 혼용해서 사용하는 방법

여러 카메라 제조사와 인터페이스를 혼용해서 사용하는 방법여러 카메라 제조사와 인터페이스를 혼용해서 사용하는 방법 장비의 일부 카메라를 다른 제조사, 다른 인터페이스로 바꾸고 싶다. 카메라 제조사, 인터페이스를 혼용 하면 문제가 될까? 머신비전 카메라를 사용할 때 장비의 카메라를 한 가지 제조사로 통일하는 것은 큰 문제가 되지 않습니다. 엔지니어가 꺼리는 상황은 한 장비에서 여러 카메라 제조사를 혼용하는 것인데, 카메라를 혼용해 사용할 경우 카메라 제조사마다 별도의 SDK를 설치해야 하며, 그로 인해 힘들게 개발한 프로그램에서 예기치 않은 에러가 발생할 수 있기 때문입니다. 인터페이스와 제조사까지 혼용하게 되면 객체 구조와 SDK 모든 것이 다르기 때문에 이렇게 사용했을 때 발생하는 에러는 해결하기 쉽지 않습니다. 카메라, 인터페이스의 선택 고민하지 마세요. 카메라 제조사와 인터페이스로부터 자유로워지는 방법 카메라와 인터페이스로부터 자유로워지는 방법이 있습니다. 몇몇 라이브러리 제조사에서 그 기능을 제공하고 있습니다. GigE Camera의 경우 GenIcam 규약에 맞춰져 있기 때문에 카메라 제어는 문제가 안 되며, 모든 제조사와 범용으로 호환되도록 설계되어 있습니다. 인터페이스가 다른 경우도 동일합니다. CoaXPress 인터페이스와 GigE 인터페이스를 동일한 객체 구조에서 사용할 수 있기 때문에 프로그램을 크게 수정할 필요가 없습니다. eGrabber SDK 동글이 있는 설비 vs 없는 설비 Euresys에서 출시한 eGrabber Studio를 사용해 장비 프로그램을 구축한다면, 이후에 CoaXPress와 GigE 인터페이스를 혼용하더라도 문제없이 사용할 수 있습니다. 물론 카메라 제조사가 달라도 eGrabber Studio를 통해 모든 객체는 통합되기 때문에 전혀 문제 되지 않습니다. 카메라, 인터페이스 선택의 폭을 넓힌 eGrabber 카메라 원가 절감과 카메라 납기 트러블까지 한 번에 해결할 수 있나요? 저렴한 카메라와 고사양 카메라를 장비의 사용 환경에 맞게 적용해서 원가를 낮출 수 있을 뿐만 아니라 카메라의 납기로 인해 다른 메이커로 변경이 필요할 때도 큰 고민 없이 검토할 수 있습니다.

2022.07.19 -

머신비전 카메라 CoaXPress 인터페이스 제대로 알아보기

머신비전 카메라 CoaXPress 인터페이스 제대로 알아보기코엑스프레스 인터페이스 제대로 사용하는 방법 머신비전 카메라 CoaXPress 인터페이스란? 이 표준은 2008년 11월 처음 선보였으며, 2009년 초에 6개 회사인 Adimec, Eqcology, Active Silicon, AVAL DATA, NED 및 Components Express로 구성된 산업 기업의 표준 협회가 구성되었습니다. 2009년 이 협회는 비전 상을 수상하면서 JIIA에서 CoaXPress를 공식 표준으로 채택하였고, 2010년 12월에 첫 버전 1.0이 출시되었습니다. CoaXPress 표준 1.0, 1.1의 경우 6.25Gbit/s (CXP-6)를 지원하며, 2019년 출시한 CoaXPRess 표준 2.0에서는 12.5Gbit/s(CXP-12)를 지원합니다. CoaXPress 인터페이스는 머신 비전, 의료 이미징, 생명 과학, 방송, 국방, 스포츠 등과 같은 전문, 산업용 이미징 어플리케이션에서 고속 이미징을 위한 인터페이스 표준으로 자리 잡았습니다. 2021년 1월 CoaxPress 2.1이 JIIA에 표준으로 지정되었으며, 몇 가지 기능이 개선되었습니다. CoaXPress 인터페이스의 장점? CoaXPress 4개의 케이블에 CXP-12를 연결할 경우 최대 전송속도는 50Gbps 또는 5GByte/s 이기 때문에 12메가 10bit 이미지를 기준으로 300fps으로 전송받을 수 있으며, 8bit 16K 라인스캔 센서는 30KHz/s의 속도로 전송받을 수 있습니다. CXP 버전에 따른 최대 데이터 전송량(1lane 기준) 기존에 많이 사용 중인 Camera Link, USB 인터페이스의 케이블 길이에 대한 아쉬움을 덜어낼 수 있습니다. 데이터 전송 속도에 따른 케이블 사용 길이 CoaXPress를 사용해 고해상도 이미지를 분산처리하는 방법 CoaXPress 인터페이스의 가장 큰 장점인 고해상도 이미지를 빠르게 전송할 수 있다는 것입니다. 하지만 PC 1대에서 50메가 이상의 고해상도 이미지를 빠르게 처리하기 어렵습니다. 원활히 검사하기 위해서는 여러 대의 PC가 필요한데 그 문제를 해결하기 위해 Data Forwarding 기술이 등장했습니다. 카메라 Data Forwarding 방법 (예시 : Euresys Coaxlink G3 DF) Euresys의 Coaxlink Quad G3 DF Frame Grabber를 사용할 경우 고해상도 이미지를 순식간에 여러 PC로 전송할 수 있기 때문에 PC마다 각각 다른 검사를 실행해 PC의 부하를 줄여 빠른 검사가 가능하게 됩니다. CoaXPress 단일 케이블로 할 수 있는 4가지 기능 CoaXPress 인터페이스는 많이 알려진 동축 케이블 입니다. 한 가닥의 동축케이블은 아래 4가지 기능을 동시에 할 수 있습니다. 이미지 데이터 수신 카메라 컨트롤 전원 소프트웨어 트리거 CoaXPress 인터페이스의 장점 CoaXPress 인터페이스 커넥터의 종류 CoaXPress 인터페이스의 대표적이 커넥터는 3가지 입니다. BNC Micro BNC DIN 1.0/2.3 CXP-6 버전까지는 DIN 1.0/2.3 커넥터가 많이 사용되었으나, 내부 구조상 접촉 불량 사례가 많아지면서 전송량이 높은 CXP-12 버전부터는 Micro-BNC 커넥터를 사용하게 되었습니다. CoaXPress 인터페이스 커넥터의 종류 CoaXPress를 더 안전하고 더 빠르게 사용하는 방법은 광통신 SFP+ CoaXPress는 구리선으로 데이터를 전송합니다. 물리적으로 케이블 길이의 한계와 데이터 송신의 한계가 분명 존재합니다. 이 한계를 극복하기 위해 CoaXPress 인터페이스에 광 통신 케이블을 접목한 SFP+ 인터페이스가 새롭게 출시되었습니다. 프로토콜은 CoaXPress를 기본으로 사용하기 때문에 전송 방식만 광 통신으로 변경된 인터페이스 입니다. SFP+는 광 통신 케이블의 장점은 아래와 같습니다. CoaXPress SFP+ 인터페이스의 장점과 단점 장점 케이블의 길이는 40Km로 매우 깁니다. 광 섬유 1개당 최대 25Gbs의 대역폭을 가집니다. 전기 노이즈의 영향을 받지 않습니다. 구리선보다 가볍기 때문에 항공기와 같이 무게가 중요한 어플리케이션에 유리합니다. 단점 빛으로 전기를 보낼 수 없기 때문에 카메라 전원은 별도로 지원해야 합니다. CoaXPress 인터페이스 광케이블(SFP+)의 장점 머신비전 카메라 인터페이스의 발전 머신비전 카메라 인터페이스의 선택은 장비를 구성함에 있어서 매우 중요합니다. 머신비전 장비는 더 높은 검사 정도와 더 빠른 검사를 하기 위해 진화합니다. 그렇기 때문에 이미지 센서 또한 더 높은 해상도와 더 빠른 속도로 발전해 왔으며, 넓은 대역폭의 데이터를 안정적으로 전송하기 위해 새로운 인터페이스를 머신비전 시스템에 도입하게 되었습니다. 인터페이스 별 비교 그래프

2022.07.19 -

머신비전 카메라 Camera Link 인터페이스 제대로 알아보기

머신비전 카메라 Camera Link 인터페이스 제대로 알아보기머신비전 카메라 Camera Link 인터페이스 제대로 알아보기 머신비전 카메라 Camera Link 인터페이스란? Camera Link는 카메라, 케이블 및 프레임그래버를 포함해 과학 및 산업용 비디오 제품을 표준화 하기위해 설계되었으며, 글로벌 표준은 AIA(Automated Imaging Association)에서 유지 관리 합니다. Camera Link Interface Standard(1.0)은 2000년 10월에 발표되었으며, 1.1은 2004년, 1.2는 2007년에 채택하였고, Mini라고 불리는 SDR과 파워를 함께 공급하는 POCL이출시되었습니다. 2012년 2.0으로 업되이트 되며, 이전 버전과 정식 규격으로 통합 되었습니다. 현재 사용하는 버전은 2.1 버전 입니다. Camera Link는 확장성에 따라, Base, Medium, Full, Full Deca로 나눠져 있습니다. (출처 : https://www.automate.org/a3-content/vision-standards-camera-link) Camera Link 인터페이스의 장점? Camera Link 인터페이스의 장점은 높은 대역폭입니다. 하나의 케이블로 255MB/s의 높은 대역폭을 내며, 두개의 케이블로는 최대 850MB/s의 대역폭을 보장합니다. Camera Link 케이블의 종류 Camera Link 케이블은 크게 두가지가 있습니다. Camera Link Standard 라고 부르는 MDR 커넥터와 Camera Link Mini 라고 부르는 SDR 커넥터가 있습니다. 과거 Standard가 Cameralink 인터페이스의 표준이였으나, 센서의 크기와 카메라 크기가 작아짐에 따라 Camera Link Mini Cable이 개발되었고, 지금은 MDR보다 SDR이 더 많은 비중을 차지하고 있습니다. Camera Link 케이블로 카메라 전원을 공급받는 POCL도 일반 Camera Link 커넥터와 동일한 커넥터를 사용합니다. Camera Link 인터페이스의 케이블을 길고 안정적으로 사용하는 방법 Camera Link Cable의 권장 길이는 Base 기준 7m, Full 기준 5m 이지만, 실제 장비의 컨디션이 좋은 경우 10m 까지 사용하는 경우도 있습니다. 하지만 장비의 안정적인 운용을 컨디션에 의존할 수 없습니다. 하드웨어 구성품 중 Camera Link 리피터를 이용하면 카메라 기준 길이의 최대 2배까지 사용 가능하기 때문에 10m 이상의 길이를 사용할 때는 권장하고 있습니다. Cameralink Cable 길이 연장하는 방법 - 리피터 Camera Link 리피터를 사용하지 않고 쉽게 케이블 길이를 늘릴 수 있는 방법은 Euresys사의 Grablink Series를 사용하는 것입니다. Grablink Series에는 Ecco, Ecco+ 기능이 내장되어 있어 Grablink Base와 Grablink Full의 경우 케이블 길이를 늘리거나 같은 길이에서 전송속도를 최대 30%까지 높여 사용할 수 있으며, Grablink Full XR의 경우 최대 2배까지 사용할 수 있습니다. Cameralink Cable 길이 연장하는 방법 - Euresys Grablink Series의 ECCO/ECCO+ 기능 한 대의 카메라 이미지를 두 대의 PC에서 받는 방법 고해상도 이미지를 분석하는 경우 PC 한 대에서 처리하기 어려운 경우가 있습니다. 이러한 경우, 한 카메라에서 여러 이미지를 취득 후 PC 마다 다른 검사를 시행할 수 있습니다. 스플리터를 사용하게 되면 Master PC는 카메라 제어를 담당하고, Master PC / Slave PC 모두 이미지 취득이 가능하여, 고해상도 이미지를 효율적으로 처리할 수 있습니다. 스플리터를 이용한 이미지를 취득하는 방법 예시 머신비전 카메라 인터페이스의 발전 머신비전 카메라 인터페이스의 선택은 장비를 구성함에 있어서 매우 중요합니다. 머신비전 장비는 더 높은 검사 정도와 더 빠른 검사를 하기 위해 진화합니다. 그렇기 때문에 이미지 센서 또한 더 높은 해상도와 더 빠른 속도로 발전해 왔으며, 넓은 대역폭의 데이터를 안정적으로 전송하기 위해 새로운 인터페이스를 머신비전 시스템에 도입하게 되었습니다. 인터페이스 별 비교 그래프

2022.07.19 -

머신비전 카메라 GigE 인터페이스 제대로 알아보기

머신비전 카메라 GigE 인터페이스 제대로 알아보기머신비전 카메라 GigE 인터페이스 제대로 알아보기 머신비전 카메라 GigE 인터페이스에 대하여 머신비전 카메라 GigE 인터페이스의 역사 GigE Vision은 고성능 산업용 카메라를 위해 2006 년에 도입된 인터페이스 표준입니다. 이더넷 네트워크를 통해 고속 비디오 및 관련 제어 데이터를 전송하기 위한 프레임 워크를 제공합니다. GigE Vision은 AIA(Automated Imaging Association)에 의해 제정되었습니다. 이 표준을 따르면 GigE Vision을 준수하는 카메라와 S/W라면 제조사 상관없이 서로 데이터를 주고받을 수 있습니다. GigE 인터페이스의 장점? GigE Vision 인터페이스의 장점 중 손꼽을 수 있는 것은 단연 확장성입니다. 대형 장비에 여러대의 카메라 링크 카메라를 설치한다고 가정한다면, 일반적으로 PC, Frame Grabber, 케이블, 케이블 리피터, 전원 등 다양한 구성품이 필요합니다. 만일 전원까지 공급하는 POE GigE Vision 인터페이스를 사용한다면, 이더넷 케이블로 데이터와 전원을 모두 공급하기 때문에 머신비전 구성품을 단순화 할 수 있습니다. 또한 네트워크 허브를 이용해 모든 카메라 펌웨어 업데이트를 한 PC에서 진행할 수 있으며, 공간별로 PC 1대씩 구성해 카메라 그룹을 만들 수 있습니다. 최대 100m 까지 사용 가능한 GigE 케이블 덕분에 영상 노이즈에 영향을 줄 수 있는 서보 모터와 같은 장치로부터 멀리 떨어져 설치 가능하여 최적의 환경을 만들 수 있습니다. GigE 케이블의 종류 GigE 케이블은 흔히 이더넷 케이블과 동일한 커넥터 규격으로 RJ45를 사용하거나 방수 방진 애플리케이션에 사용하는 카메라는 8-Pin M12 Socket을 사용하기도 합니다. 다 똑같이 생긴 GigE 케이블도 여러가지 버전(CAT.3 ~ CAT.8)이 있으며, 단위는 카테고리로 부릅니다. 머신비전에서 사용 가능한 버전은 CAT5e부터 CAT.7입니다. 아래 표에는 카테고리별 전송 사양에 대한 설명입니다. UTP 케이블 비교 CAT.5 CAT.5e CAT.6 CAT.6A CAT.7 전송속도 100Mbps 1Gbps 1Gbps 10Gbps 10Gbps 주파수 100MHz 100MHz 250MHz 500MHz 600MHz 규격 100BASE-TX 1000BASE-T 1000BASE-TX 10GBASE 10GBASE GigE 케이블의 내부 구조 GigE 인터페이스의 랜 케이블은 겉에서 보기에는 비슷하게 생겼지만 내부 구조가 다릅니다. 카테고리별 전송량에 따라 차폐 방식, 차폐 구조에 차이가 있습니다. GigE Vision은 1Gbps를 지원하는 CAT.5e 이상 규격의 케이블을 사용해야 합니다. GigE Vision 신뢰할 수 있는 이유 GigE Vision 애플리케이션에서 빠른 전송속도가 중요하기 때문에 GigE Vision은 UDP 프로토콜을 사용해 패킷을 전송합니다. 일반적으로 TCP가 패킷 전달 안정성이 높지만 이것을 보완하기 위해 GigE Vision 표준은 UDP패킷에 헤더를 추가하는데 헤더에는 이미지 번호, 패킷 번호, 타임스탬프 정보를 갖고 있습니다. 이 헤더 정보를 보고 데이터의 순서를 재정렬 하며, 누락된 패킷이 도착할 때까지 기다리는 시간 설정을 하여 안정성을 높일 수 있습니다. GigE Vision의 패킷 전송방식 GigE Vision 기본 설정에서 점보 프레임을 최대치로 올리는 이유 위 과정에서 필요한 오버헤드 정보는 패킷 단위로 생성됩니다. 패킷이 세분화될수록 헤더가 차지하는 공간이 많아지기 때문에 데이터 전송에 영향을 받습니다. GigE 카메라의 프레임 레이트가 떨어진다면 확인해야 하는 3가지 필수 설정이 있습니다. 아래 짧은 동영상 가이드를 보고 네트워크 카드의 설정을 마무리하면, GigE Vision 카메라의 데이터 전송 안정성이 향상됩니다. GigE Vision 점보패킷을 최대로 올리는 이유 GigE Vision 네트워크 카드 필수 설정 3가지 머신비전 카메라 인터페이스의 발전 머신비전 카메라 인터페이스의 선택은 장비를 구성함에 있어서 매우 중요합니다. 머신비전 장비는 더 높은 검사 정도와 더 빠른 검사를 하기 위해 진화합니다. 그렇기 때문에 이미지 센서 또한 더 높은 해상도와 더 빠른 속도로 발전해 왔으며, 넓은 대역폭의 데이터를 안정적으로 전송하기 위해 새로운 인터페이스를 머신비전 시스템에 도입하게 되었습니다. 인터페이스 별 비교 그래프 아래 머신비전 인터페이스 비교표를 참고하면 수치를 통해 비교할 수 있습니다. 인터페이스 규격 대역폭 케이블 길이 전원공급 보드 CoaxPress CXP-3 / 1-lane 기준 3.125 Gbit/s (325MB/s)* 100m 가능 (POCXP) 필요 CXP-6 / 1-lane 기준 6.25 Gbit/s (625 MB/s)* 75m 가능 (POCXP) CXP-12 / 1-lane 기준 12.5 Gbit/s (1,250 MB/s)* 30m 가능 (POCXP) Camera Link Base 2.04 Gbit/s (255 MB/s) 7m 가능 (POCL) Midium 4.08 Gbit/s (510 MB/s) 5m 가능 (POCL) Full 5.44 Gbit/s (680 MB/s) 5m 가능 (POCL) Full Deca 6.8 Gbit/s (850 MB/s) 5m 가능 (POCL) USB USB 2.0 480Mbit/s (60MB/s) 5m 가능 USB 3.2 Gen1 5 Gbit/s (625MB/s) 5m 가능 USB 3.2 Gen2 10 Gbit/s (1,250MB/s) 5m 가능 GigE GigE 1 Gbit/s (125MB/s) 100m 가능 (POE) 5 GigE 5 Gbit/s (625MB/s) 100m 가능 (POE) 10 GigE 10 Gbit/s (1,250MB/s) 37m 미지원 머신비전 전문가 화인스텍과 상담하세요. 애플리케이션 요구사항에 맞춰 완벽한 솔루션을 찾아드립니다.

2022.07.19